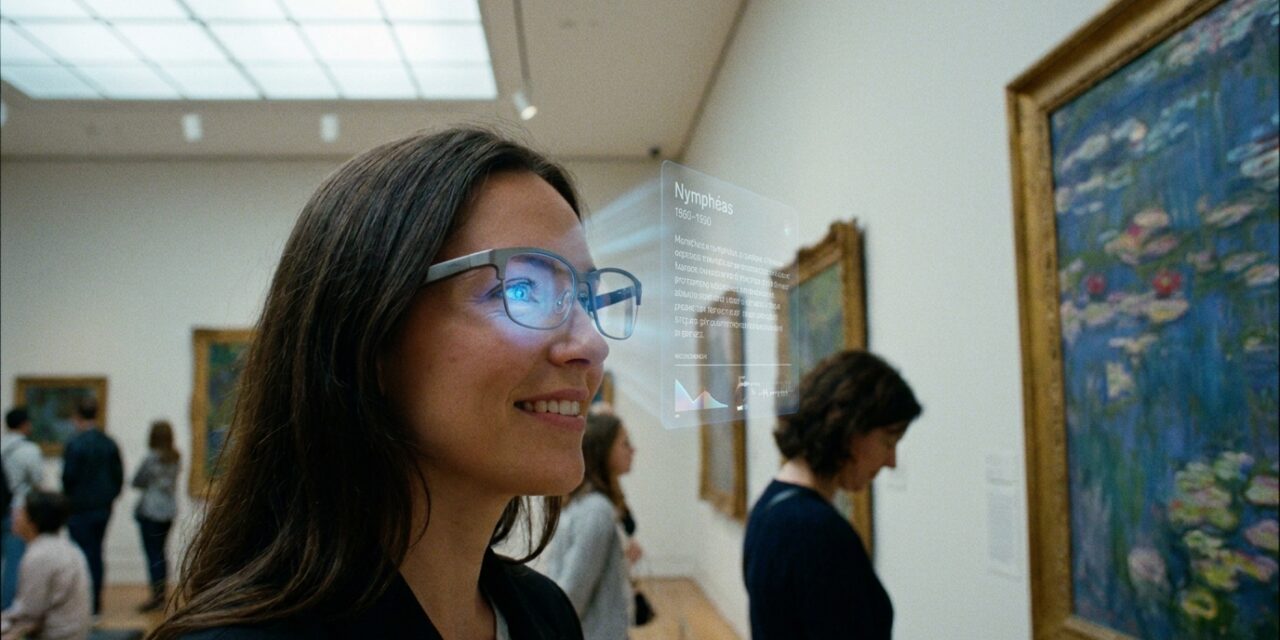

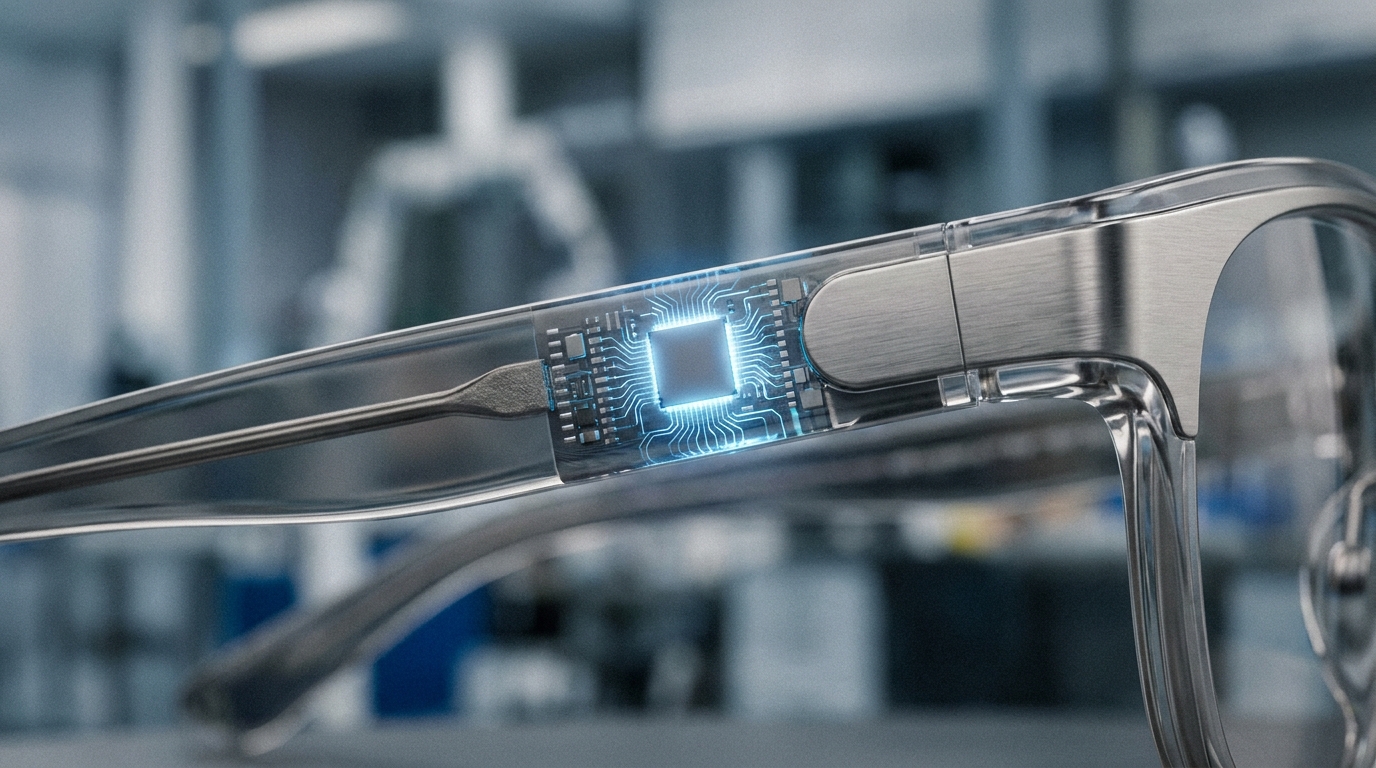

L’intelligence artificielle ne se limite plus à votre smartphone ou à votre ordinateur ; elle se pose désormais sur votre nez, directement dans vos lunettes. Chaque fois que vous parlez ou que vous regardez une scène, une véritable chaîne de calcul se met en marche. Cette explication détaillée vous aidera à comprendre les coulisses : comment les modèles LLM et SLM se complètent, et comment le traitement local ou dans le cloud influence rapidité, confidentialité et confort.

IA dans lunettes explication : LLM, SLM, traitement local vs cloud

Temps de lecture : ~11 min

- Sommaire

- Pourquoi l’IA dans les lunettes change tout

- LLM et SLM : comment les modèles de langage s’invitent dans vos lunettes IA

- Traitement local ou cloud : explication complète

- Schéma simplifié du traitement d’une requête vocale

- Comment choisir la bonne architecture

- FAQ rapide

Pourquoi l’IA dans les lunettes change tout

Les premières lunettes connectées se limitaient à quelques fonctions (notifications, photos, pilotage basique). Avec l’IA, elles deviennent des assistants personnels permanents, capables de comprendre et de générer du contenu contextuel.

- Traduction instantanée de conversations étrangères avec sous-titres affichés devant vos yeux

- Reconnaissance d’objets, de lieux et parfois de personnes pour fournir des informations en contexte

- Mémoire visuelle pour retrouver plus tard ce que vos lunettes ont déjà vu

- Fonctions d’accessibilité : lecture à voix haute, description d’environnement, transcription en temps réel

Derrière ces usages se trouvent des modèles de langage (LLM ou SLM) et une architecture de calcul partagée entre lunettes, téléphone et cloud. Découvrez comment cela fonctionne plus concrètement dans notre article sur le fonctionnement des lunettes IA.

LLM et SLM : comment les modèles de langage s’invitent dans vos lunettes IA

Une simple commande comme « Que vois-tu ? » ou « Traduis ce que cette personne dit en anglais » passe toujours par un modèle de langage chargé d’interpréter, d’analyser le contexte visuel et de générer la réponse.

LLM : grands modèles pour la puissance maximale

Les LLM regroupent des milliards de paramètres, s’exécutent presque toujours dans le cloud et excellent pour les raisonnements complexes, la traduction de haute qualité ou l’analyse de contexte riche. Leur principal inconvénient : la latence liée à l’envoi de données vers un serveur distant.

SLM : petits modèles pour la réactivité et le temps réel

Compactes, ces versions légères peuvent tourner sur le téléphone, parfois même dans la monture. Elles répondent quasi instantanément ; idéales pour la traduction de quelques phrases ou les commandes vocales simples, au prix d’une polyvalence moindre.

| Critère | LLM (cloud) | SLM (local) |

|---|---|---|

| Taille du modèle | Milliards de paramètres | Millions de paramètres |

| Latence moyenne | Plus élevée (dépend du réseau) | Très faible |

| Consommation énergétique | Déportée sur serveurs | Basse, sur appareil |

| Cas d’usage typiques | Analyses complexes, contenu créatif | Sous-titres en direct, commandes courtes |

Traitement local ou cloud : explication complète

Où s’exécute réellement l’intelligence ? Trois possibilités coexistent : dans le cloud, sur des serveurs locaux, ou directement dans l’appareil.

Quand le cloud porte l’intelligence de vos lunettes

Avantages : accès à des LLM géants constamment mis à jour ; aucune infrastructure à gérer côté utilisateur.

Inconvénients : dépendance totale au réseau ; latence perceptible pour la traduction en direct ; questions de confidentialité lors du transit des données.

Quand le traitement local reprend la main

Points forts : contrôle des données ; latence réduite lorsque les serveurs sont proches ou embarqués ; coûts prévisibles en interne.

Limites : investissement matériel important ; compétences techniques requises pour la maintenance.

Le modèle hybride : la combinaison la plus réaliste

Les tâches sensibles et très réactives restent locales, tandis que les requêtes rares ou lourdes partent vers le cloud. On obtient ainsi un bon compromis entre performance, confidentialité et coûts. Pour aller plus loin, parcourez notre blog spécialisé sur les lunettes IA pour retrouver des exemples et dossiers pratiques.

| Aspect | Cloud | Local | Hybride |

|---|---|---|---|

| Latence | Moyenne à élevée | Faible | Faible à moyenne |

| Confidentialité | Variable | Maîtrisée | Équilibrée |

| Coût initial | Faible | Élevé | Moyen |

| Exemple d’usage | Analyse approfondie | Commande vocale simple | Traduction améliorée |

Schéma simplifié du traitement d’une requête vocale

Étape 1 : le micro capture votre voix, immédiatement convertie en texte par une IA locale.

Étape 2 : un modèle de langage (SLM local ou LLM cloud) identifie l’intention : traduire en espagnol.

Étape 3 : la caméra isole la personne qui parle ; un module de reconnaissance vocale extrait son discours.

Étape 4 : un moteur de traduction traite le texte source ; s’il est hybride, une première version locale peut être raffinée via le cloud.

Étape 5 : le texte traduit revient aux lunettes et s’affiche à côté de l’orateur.

Étape 6 : le cycle se répète en continu, profitant du contexte accumulé pour accélérer la suite.

Comment choisir la bonne architecture

Les critères pour expliquer et choisir l’IA dans vos lunettes

1) Niveau de contrôle des données : pour des informations médicales ou juridiques, privilégiez le local ou un LLM open-source sur vos serveurs.

2) Stabilité de l’usage : volume prévisible ? l’infrastructure interne devient rentable ; usages irréguliers ? le cloud reste flexible.

3) Compétences internes : absence d’équipe dédiée ? optez pour un modèle hybride où le cloud gère les tâches lourdes.

Pour l’utilisateur final, ces choix se traduisent par des variations de réactivité, de respect de la vie privée et de richesse fonctionnelle hors connexion.

FAQ rapide

Les lunettes IA fonctionnent-elles sans connexion internet ?

Partiellement : commandes vocales simples, prise de notes ou description basique peuvent rester locales ; les traductions de haute qualité nécessitent souvent le cloud.

Différence entre lunettes connectées et lunettes IA ?

Les premières se contentent d’afficher des informations du téléphone ; les secondes comprennent, interprètent et génèrent du contenu grâce à l’IA.

Les données sont-elles enregistrées en continu ?

En général non : un déclencheur (commande vocale, geste) active l’enregistrement, souvent anonymisé ou limité.

Un LLM cloud est-il toujours meilleur qu’un SLM local ?

Non : un SLM bien calibré fournit souvent une réponse « assez bonne » plus rapidement et sans dépendance réseau.

L’IA dans les lunettes va-t-elle remplacer le smartphone ?

Pas à court terme ; elle le complète en offrant un accès mains libres, tandis que le téléphone reste central pour connectivité et stockage.

Conclusion : explication complète de l’IA dans les lunettes au quotidien

En comprenant comment LLM, SLM, cloud et traitement local coopèrent, vous pouvez mieux évaluer les promesses des nouvelles lunettes IA. Retrouvez d’autres ressources sur le blog Lunettes IA.